![]()

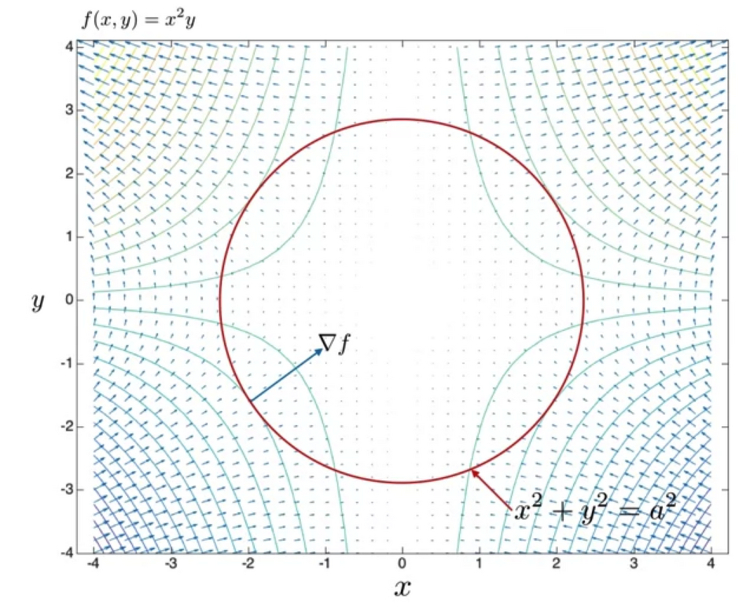

1. Constrained optimisation 이전에 다루었던 함수 f(x,y) = x^2y에 대해서 contour를 생성하면 오른쪽 그림과 같다. 우리는 gradient vector를 통해 최댓값을 갖는 x,y 지점에 이를 수 있다. 이때 최댓값에 이를 수 있는 x,y 쌍의 범위를 원의 형태로 제한(constraint)할 수 있고 이를 함수 g로 표현 가능하다. 위에서 살펴본대로 f의 값을 최대화하기 위해 제약(constraint) g 함수를 이용할 수 있다. 이때 두 벡터가 만나는 지점을 구하는 방정식에 Lagrange multiplier가 이용된다. 위 방정식을 통해 Lagrange multiplier를 구하고 이를 기존의 식에 다시 대입하여 x와 y의 식을 재구성한다. 결과적으로 f를 최대화,..

![]()

1. Welcome to Module 5! 최적의 평균과 분산을 구하는 방법에 대해 생각해보자. 어떤 함수에 대해 임의의 x값을 대입하고 그 미분계수를 통해 반복적으로 최적의 x값을 찾아나갈 수 있다. 이때 함수값을 미분계수로 나눈 값을 빼는 방식을 '반복(iterate)'하면 된다. 이런식으로 과정을 반복하는 방법을 'Newton-Raphson'이라고 부른다. 시작값을 잘못 설정하면 위와 같이 closed loop에 갇힐 수 있다. 혹은 너무 작은 미분계수를 갖는 점에서 시작하면 x의 변화량이 거의 없어서 의미 없는 학습을 반복하게될 가능성이 있다. 2. Newton-Raphson in one dimension (Quiz) 도함수 구하기 다항함수에 대해 미분을 수행한 결과를 직접 입력하면 된다. New..