![]()

관심 있는 NLP 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success [Microsoft] - 학습 동안에 residual path를 추가하고, 추론 시에는 extra path를 제거하는 merging을 적용한 ResLoRA - LoRA와 residual path를 결합한 최초의 방법론� 출처 : https://arxiv.org/abs/2402.18039 ResLoRA: Identity Residual Mapping in Low-Rank Adaption As one of the most popular parameter-efficient fine-tuning (PEFT) methods, low-rank adapta..

![]()

관심있는 NLP 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success - 많은 LoRA adapters를 scalable하게 serving할 수 있도록 designed된 system, S-LoRA - Unified Paging, custom CUDA kernels를 도입� 1. Introduction "pretrain-then-finetune" 패러다임이 성행함에 따라 수많은 variants가 생성됨 Low-Rank Adaptation (LoRA)와 같은 parameter-efficient fine-tuning (PEFT) method가 발전됨 원조 LoRA는 adapter의 파라미터를 기존 모델의 파라미터와 me..

![]()

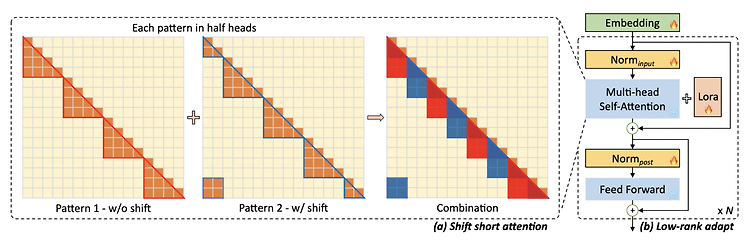

최근(2023.09)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success [MIT] 사전학습된 LLM의 context size를 확장하는 efficient fine-tuning 기법, LongLoRA. sparse local attention 방식 중 하나로 shift shoft attention(S^2-Attn)를 제안하고, trainable embedding & normalization을 통해 computational cost를 대폭 줄이면서도 기존 모델에 준하는 성능을 보임. Fine-tugning을 위한 3K 이상의 long context question-answer pair dataset, Lon..

![]()

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ 여러 개의 LoRA 모듈을 구성하여 task 간 일반화 성능이 뛰어난 LoRA 허브를 제시. few-shot 상황에서 in-context learning 능력이 준수함을 BBH(Big-Bench Hard) 벤치마크로 검증 배경 모델의 학습 가능한 파라미터수가 날이 갈수록 늘어나자 이를 최소화하며 동일한 성능을 유지하고자 하는 연구들이 이어지고 있습니다. 그중에서도 행렬 분해를 통해 학습 가능한 파라미터의 수를 획기적으로 줄이면서 기존의 성능에 버금가는 모델이 될 수 있도록 하는 학습 방식으로, LoRA가 가장 크게 주목을 받았죠. 하지만 이는 LLM이 가진 일반화 능력을 포기..

![]()

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ FLAN-MINI 데이터셋을 대상으로 LLaMA 모델을 Fine-tuning with LoRA 하여 다양한 태스크 수행 능력과 코드 해석 능력을 준수하게 끌어올린 모델, Flacuna 배경 ChatGPT를 필두로 LLM들이 다양한 분야와 태스크에서 우수한 성능을 보이고 있습니다. 그럼에도 불구하고 strong reasoning & problem solving 능력이 요구되는 태스크들에 대해서는 여전히 T-5 based 모델들이 더 좋은 퍼포먼스를 보입니다. 본 논문에서는 그 주요 원인을 (1) Pre-training data, (2) Backbone architecture, ..

![]()

최근(2023.06)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success [Meta] 기존의 parameter-efficient fine-tuning(PEFT) 방식들을 집대성하여 만든 fine-tuning 기법, Generalized LoRA(GLoRA) large-scale deep neural network는 지난 몇 년 간 눈부신 발전을 이룩했습니다. 특히 transformer 아키텍쳐를 기반으로 NLP 분야가 엄청나게 빠른 성장을 이룬 것에 영향을 받아, 이 아키텍쳐는 이미지 분야로까지 전파되어 기존의 연구 성과들을 다 엎을 수준의 영향을 주었죠. 이는 인공지능 모델들의 사이즈가 굉장히 커지는, ..