![]()

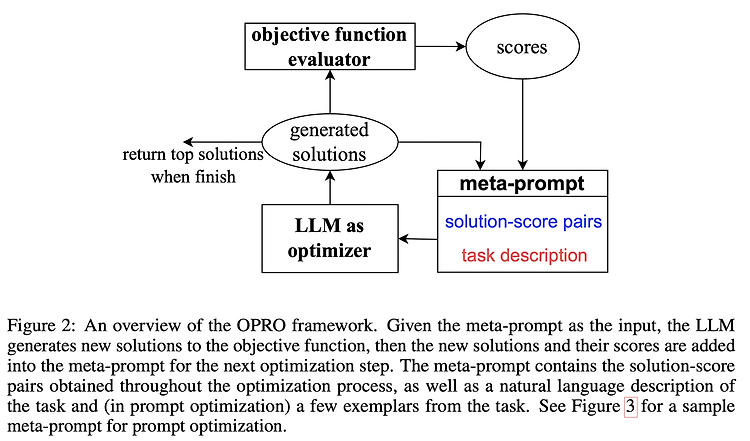

최근(2023.09)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success [Google DeepMind] LLM에 대해 Prompting 기술을 활용하여 Optimization 하는 OPRO를 제안. Linear Regression, Traveling Salesman Problem / GSM8K, Big-Bench Hard Task 배경 원래 optimization, 최적화라고 하면 주어진 문제를 풀기 위해 정의된 objective fuction에 대한 최적화를 뜻합니다. 목표로 설정한 함수를 최적화하는 것은 solution을 반복적으로 업데이트함으로써 달성됩니다. 지금까지는 어떤 방식으로 solution..

![]()

최근(2023.06)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success Second-order Clipped Stochastic Optimization, Sophia. diagonal Hessian을 이용하여 Adam보다 2배 이상 빠른 optimizer. 현재 딥러닝 분야에서 가장 널리 쓰이는 optimizer는 Adam family입니다. 더 큰 사이즈의 모델들이 더 좋은 성능을 보인다는 scaling law에 따라 요구되는 연산량은 점점 증가하는 추세이고, 본 논문과 같은 연구는 이를 최소화하기 위한 노력의 일환으로 볼 수 있습니다. 오늘은 Sophia라는 optimizer의 특징을 간단히 정리해보..