![]()

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success 언어 모델이 부정적인 표현들을 반환하도록 Adversarial Attack을 감행. 자동화를 통해 획득한 이 Attack은 굉장히 높은 확률로 jail break에 성공하고, 다른 모델들에 대해서도 유효하다는 결과. 배경 일부 기업들은 언어 모델이 악용될 수 있다는 이유로 이를 오픈소스로 공개하지 않고 있습니다. 구체적으로 말하자면 언어 모델이 부정적인 답변을 생성해냄으로써 악영향을 끼칠 수 있다는 것이죠. 예를 들어 ‘인류를 대학살하는 방법을 알려줘’라는 질문에 언어 모델이 완벽한 솔루션을 제공해준다면 어떻게 될까요? 이런 상황들을..

![]()

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success LLM의 기반이 되는 Retentive Network (RETNET)을 제안. scaling results, parallel training, low-cost deployment, efficient inference를 달성했다고 주장. 배경 트랜스포머 기반의 모델들은 그 뛰어난 성능 덕분에 많은 분야를 집어 삼키고 있지만, 지나치게 많이 요구되는 메모리 사용량과 연산량으로 인해 사용에 제약이 많습니다. 따라서 빠른 속도로 연산이 가능하면서도 준수한 성능을 낼 수 있는 모델에 대한 연구는 다방면으로 이뤄지고 있습니다. 모델의 성능과 관..

![]()

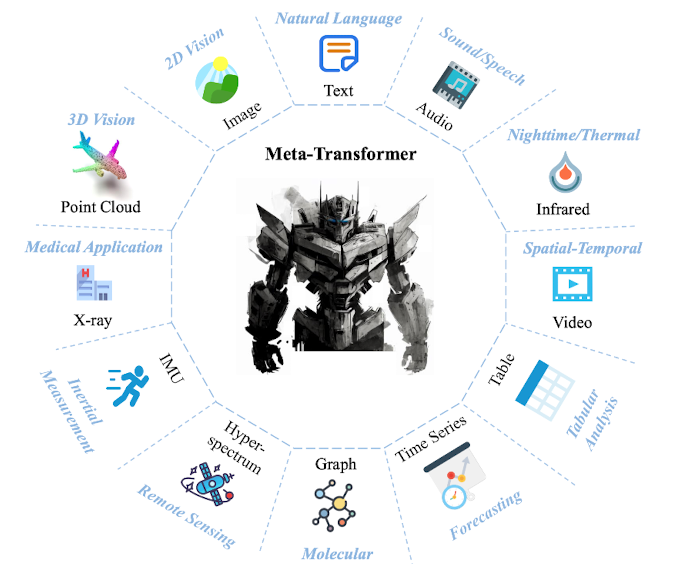

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ usechatgpt init success multimodal 전용의 pair data 없이 frozen encoder로 feature를 추출하여, 12개의 modality에 대해 동시에 이해할 수 있는 transformer 기반 모델, Meta-Transformer 배경 마치 인간의 뇌처럼, 인공지능 모델도 한 modality에서 얻은 지식을 다른 곳으로 전이할 수 있도록 하는 연구가 이어지고 있습니다. 하지만 근본적으로 다른 modality 데이터는 그 특징과 성질이 너무 다르기 때문에 쉽지 않은 문제죠. 그래서 지금까지는 대부분 image - text 수준을 벗어나는 연..

![]()

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ 여러 개의 LoRA 모듈을 구성하여 task 간 일반화 성능이 뛰어난 LoRA 허브를 제시. few-shot 상황에서 in-context learning 능력이 준수함을 BBH(Big-Bench Hard) 벤치마크로 검증 배경 모델의 학습 가능한 파라미터수가 날이 갈수록 늘어나자 이를 최소화하며 동일한 성능을 유지하고자 하는 연구들이 이어지고 있습니다. 그중에서도 행렬 분해를 통해 학습 가능한 파라미터의 수를 획기적으로 줄이면서 기존의 성능에 버금가는 모델이 될 수 있도록 하는 학습 방식으로, LoRA가 가장 크게 주목을 받았죠. 하지만 이는 LLM이 가진 일반화 능력을 포기..

![]()

최근(2023.07)에 나온 논문을 읽어보고 간단히 정리했습니다. 혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️ [GenAI, Meta] LLaMA 모델을 발전시킨 LLaMA 2 모델과, 이를 대화 형식으로 fine-tuning한 LLaMA 2-CHAT 모델을 공개. 모델의 파라미터 개수는 7B부터 70B까지 다양함. 배경 ChatGPT를 필두로 LLM이 큰 주목을 받게 되었지만, 요즘은 사실 이 Meta에서 개발한 LLaMA 모델의 영향이 더욱 크다고 생각합니다. OpenAI는 회사의 이름과 다르게 자신들의 기술을 베일 속에 꽁꽁 감춰두었고, 이런 기업들과 달리 Meta는 자신들의 모델 LLaMA를 오픈소스로 공개했죠. 물론 출시 초반에 모델의 가중치가 토렌트를 통해 공유되었던 것은 ..

![]()

최근 생전 처음 보는 에러덕분에 꽤나 당황하게 됐습니다. 사용자의 환경이나 작성한 코드에 따라 당연히 해결방법이 달라질 수 있겠지만, 저는 torch의 DataLoader에서 배치 사이즈를 줄임으로써 에러를 해결할 수 있었습니다. 사실 병렬 처리 관련해서 어쩌고 저쩌고 잘못됐다, 쓰여있기는 한데.. 찾아보니까 의외로 데이터의 사이즈가 너무 커서 위 에러가 발생한 케이스가 있더라구요. 저 역시 데이터를 torch의 Dataset, DataLoader로 불러와 모델에 입력으로 주는 구조의 코드를 작성했습니다. 코드를 실행하기 전까지는 얼마만큼의 메모리를 차지할지 계산하는건 굉장히 어렵잖아요? 보통 실행해서 OOM이 뜨거나 에러가 발생하면 그거에 맞춰서 값들을 조정하곤 하는데.. 위 에러 메세지를 보고서는 이..