![]()

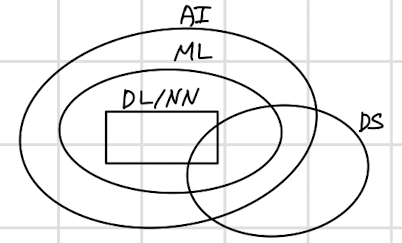

Machine learning vs. data science data science: 어떤 의사결정을 해야할지에 도움을 주는 분야 ex) 어떤 집을 사야하는가? science of extracting knowledge and insight from data machine learning filed of study that gives computers the ability to learn without being explicitly programmed. 어떤 고아고를 눌러야 하는지 알려주는 시스템 Deep learning 네 개의 input(A)를 통해 한 개의 output(B)를 만들어 냄 중간의 원들을 neuron(뉴런)이라고 부른다. Neural Network와 Deep learning은 요즘 거의 ..

![]()

Machine Learning Supervised Learning Input(A): email, audio, English... Output(B): spam, text transcript, Chinese... Application: spam filtering, speech recognition, machine translation Why now? AI가 급부상하게 된 것은 머신러닝과 인공신경망을 기반으로한 딥러닝의 발전 덕분이다. 발전 정도를 도식화하면 위와 같다. 따라서 우리는 large neural network와 big data가 필요하다고 말할 수 있다. What is data? Example of a table of data(dataset) A와 B 자리에는 무엇이든지 내가 원하는 것이 오게 될..

Introduction AI가 창출하는 가치는 매년 증가하고 있다. 다양한 분야에서 폭풍 성장중 Demystifying AI ANI(aritificial narrow intelligence) smart speaker, self-driving, car ... AGI(artificial general intelligence) do anything a human can do 인간을 지배할 거싱라는 두려움을 야기하는 분야로 볼 수 있다. 하지만 지나치게 우려할 필요는 없다. What you'll learn What is AI? Machine Learning Data What makes an AI company What machine learning can and cannot do Optional: Intuiti..

1. Eigen values and eigenvectors 3,4 차원의 고윳값과 고유벡터는 계산기를 통해 구한다. loop가 존재하면 다른 페이지로 가는 것이 아니라 cycle을 형성하게 된다. loop가 두 개 존재하면 작은 행렬로 나눠서 고윳값과 고유벡터를 찾을 수 있다. 이때는 unique PageRank가 존재하지 않는다. damping을 적용하면 계산의 크기가 작아진다. 기존 페이지에 머무를지 이동할지에 대한 가중치를 부여하는 것이 damping이다. 람다에 관한 방정식을 characteristic polynomial이라고 한다. 이 방정식으로 고윳값과 고유벡터를 구할 수 있다. 대각행렬을 이용해서 행렬의 제곱도 간단하게 구할 수 있다. 2. Summary 계산은 컴퓨터가 하기 때문에 손으로 ..

![]()

1. Introduction to PageRank 페이지 A,B,C,D의 연결 관계를 나타내는 행렬 L의 각 행을 구한 것이다. 연결된 페이지의 수를 분모로 삼아 다른 페이지로 이어질 확률을 벡터로 표현한다. 모든 페이지의 랭크가 동일하게 normalise 되었다고 가정하면 랭크 벡터 r은 위와 같다. 그리고 페이지의 연결 관계를 확률로 나타낸 벡터 L도 위처럼 표현된다. A에 대한 랭크는 페이지 벡터 L과 r의 곱으로 구할 수 있다. 이때 벡터 r을 반복적으로 곱하며 값을 업데이트한 식은 위와 같다. 이 반복은 r이 변화를 멈출때까지 계속된다. 결국 r = Lr 이 된다. 이 방정식을 풀기 위한 좋은 방정식은 사다리꼴을 만드는 것이지만, 이는 고윳벡터를 알 때만 적용 가능하다. 2. PageRank P..

![]()

1. Changing to the eigenbasis T라는 사상이 주어진 벡터를 어떻게 이동시키는지는 매번 행렬 T를 곱해보아야 알 수 있다. 그러나 시행 횟수 n이 커질수록 이 계산은 매우 복잡해지므로 간단하게 만들고자 한다. 이때 diagonal matrix(대각행렬)를 사용하면 이 과정을 간단하게 만들 수 있다. 대각행렬은 주대각선은 전부 1이고, 나머지는 전부 0인 행렬을 말한다. 대각행렬 T를 반복적으로 곱하면 주대각성분만 제곱의 형태가 된다. 고유벡터로 이루어진 행렬 C와, 단위 행렬에 고윳값을 곱한 행렬 D가 있다. T를 위와 같은 방식으로 구하면 C와 C의 역행렬이 사라지며 계산량이 확연하게 줄어들고 일반화도 가능하다. 2. Eigenbasis example horizontal shear..