관심있는 NLP 논문을 읽어보고 간단히 정리했습니다.

혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️

[Microsoft Research]

- small LMs이 각 태스크에 적합한 solution strategies를 이용하는 방법을 학습시키는 것이 목표

- 기존 모델 Orca 1 대비 강한 추론 능력을 보유할 수 있도록 학습하여 최대 10x 사이즈 모델보다도 우월한 성능을 보이는 경우가 많음을 확인함

- 배경

- LLM이 unseen tasks에 대해 문제를 잘 처리할 수 있는 zero-shot ability가 알려짐

- 그러나 단순히 Teacher model의 output을 모방하는 Imitation Learning 방식은 한계가 존재

- 따라서 여러 태스크를 처리 '결과'가 아니라 '방식'을 배워야 한다는 저자의 주장

- Related Works

- Instruction Tuning

- input은 자연어로 된 태스크 설명, output은 desired behavior인 (input, output) 쌍으로 학습

- knowledge-intensive or reasoning ability에 대한 능력이 부족하다는 것은 확인이 됨

- Explanation Tuning

- Orca 1에서 제시되었던 학습 방식으로, instruction tuning보다 훨씬 더 자세하고 일련의 추론 과정을 포함하는 explanation을 바탕으로 학습하도록 함

- system instruction은 user prompt에 관한 high level 가이드라인

- Slow thinking을 할 수 있도록 (system instruction, user prompt, LLM answer) triplet으로 데이터셋을 구축

- Instruction Tuning

- Contributions

- Prompt Erasure 테크닉을 통해 Orca 2를 Cautious Reasoner로 만들었음

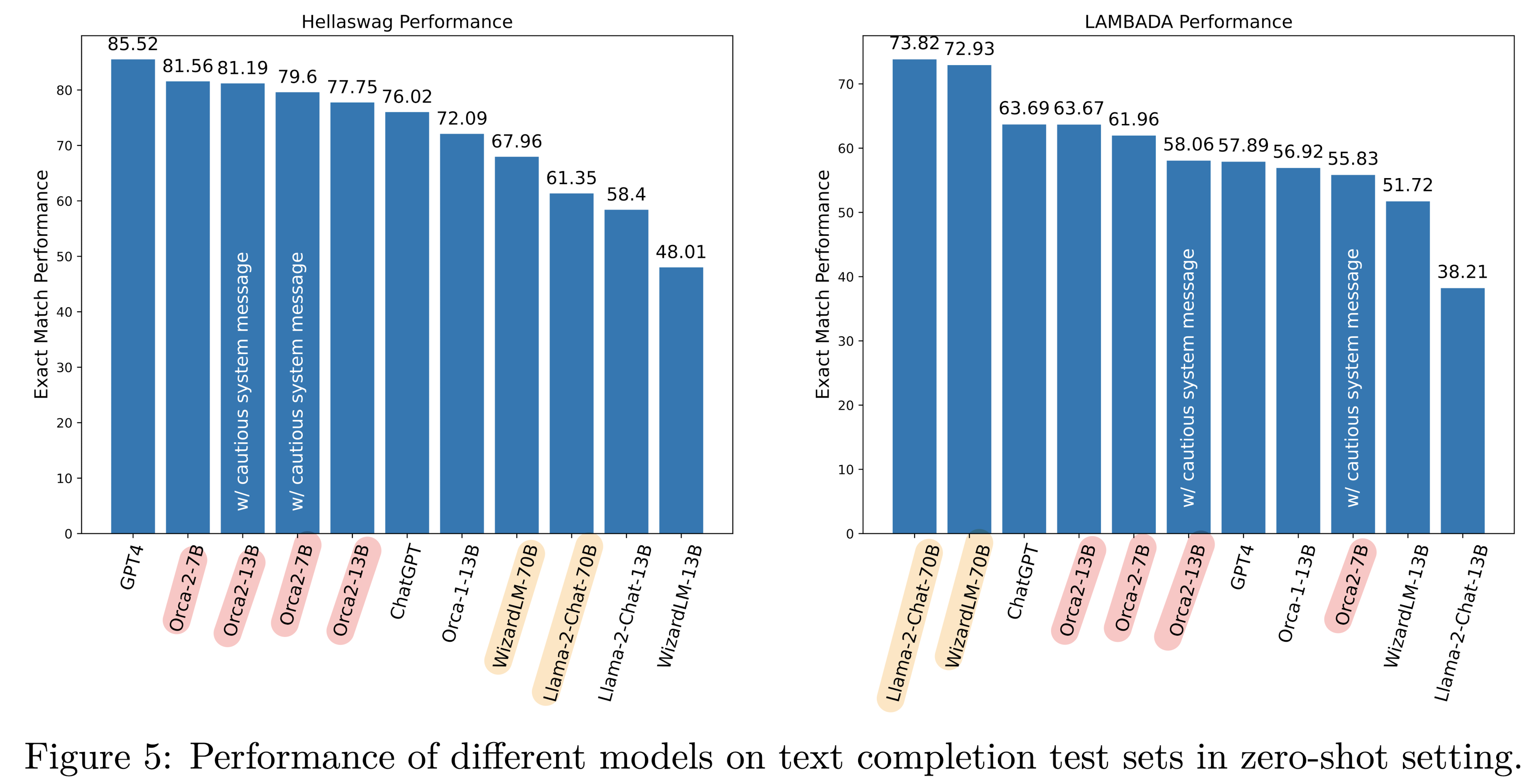

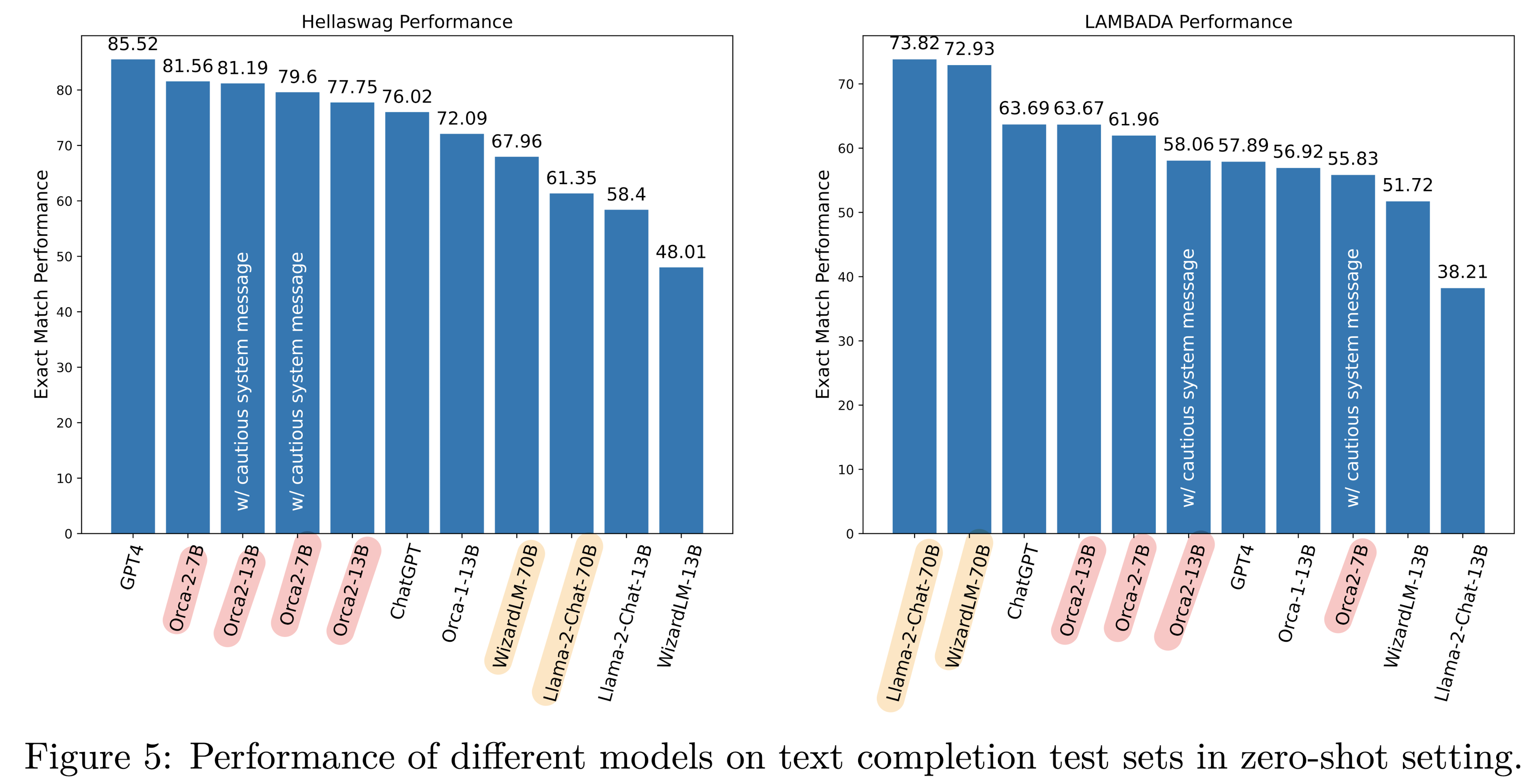

- 추론 관련 태스크에서 기존 모델 Orca 1 뿐만 아니라, 70B에 달하는 모델보다도 뛰어난 성능을 보임

- Teaching Orca 2 to be a Cautious Reasoner

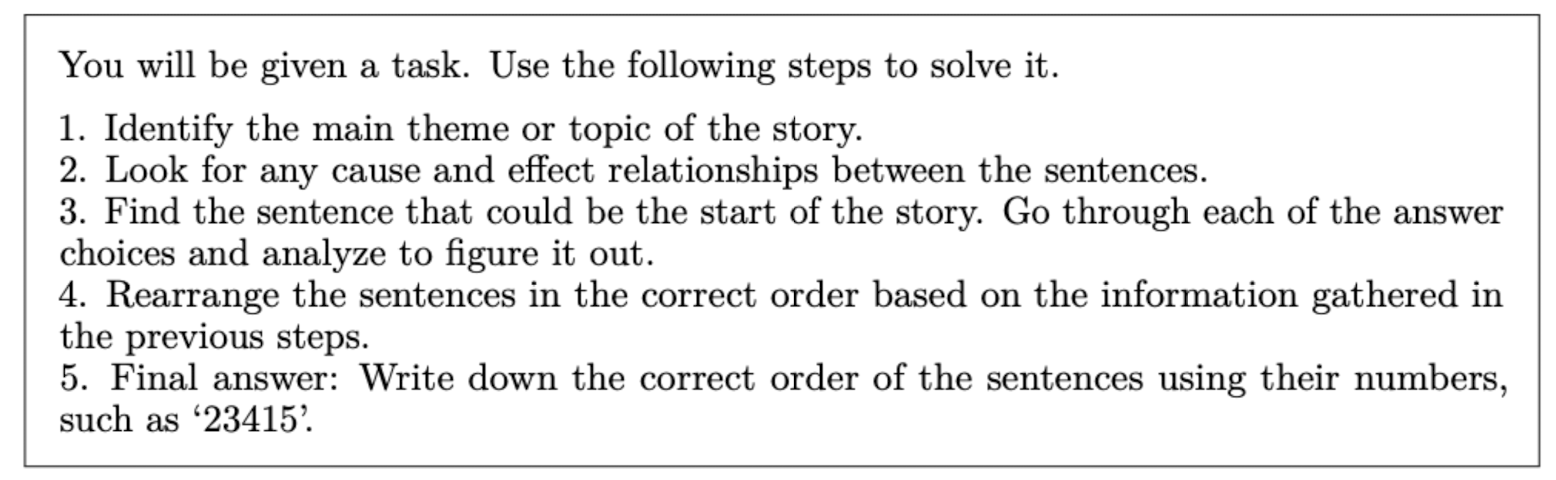

- system instruction을 크게 세 가지 유형으로 구분하여 결과를 비교했을 때, 마지막의 것이 유효한 정답을 반환하는 것이 확인됨

- 1) default GPT-4 answer

- 2) chain-of-thought prompt

- 3) explain-your-answer prompt

- 실제로 최종 결과가 정답이었다고 하더라도 이것이 smaller models에도 적합한 방식인지 생각할 필요가 있음.

이때 다음 내용을 고려해야 함- 1) 태스크마다 최적의 전략이 다르다

- 2) 작은 모델의 태스크별 최적의 전략은 큰 모델의 것과 다를 수 있다

- Cautious Reasoning: 주어진 태스크에 대해 어떤 solution strategy를 취할 것인지 결정

- 1) 다양한 태스크 모음으로 시작

- 2) Orca의 performance에 따라 태스크에 필요한 solution strategy를 결정

- 3) 태스크에 대한 teacher model의 response를 얻기 위해 task-specific system instruction을 작성

- 4) Prompt Erasing: 학습 동안에 student의 system instruction을 태스크에 대해 어떻게 접근할 것인지에 대한 detail이 비워져 있는 generic한 것으로 대체

- Dataset

- FLAN, Few Shot Data, Math, Fully synthetic data

- Baseline

- LLaMA-2 Models, WizardLM, Orca, GPT Models

- system instruction을 크게 세 가지 유형으로 구분하여 결과를 비교했을 때, 마지막의 것이 유효한 정답을 반환하는 것이 확인됨

- Chat model들이 HellaSwag와 같은 text completion에는 적합하지 않은 것으로 원인을 분석했음

- 이걸 포함해서 애초에 왜 Chat model을 썼는지 의문이기는 함

출처 : https://arxiv.org/abs/2311.11045

Orca 2: Teaching Small Language Models How to Reason

Orca 1 learns from rich signals, such as explanation traces, allowing it to outperform conventional instruction-tuned models on benchmarks like BigBench Hard and AGIEval. In Orca 2, we continue exploring how improved training signals can enhance smaller LM

arxiv.org

'Paper Review' 카테고리의 다른 글

관심있는 NLP 논문을 읽어보고 간단히 정리했습니다.

혹시 부족하거나 잘못된 내용이 있다면 댓글 부탁드립니다 🙇♂️

[Microsoft Research]

- small LMs이 각 태스크에 적합한 solution strategies를 이용하는 방법을 학습시키는 것이 목표

- 기존 모델 Orca 1 대비 강한 추론 능력을 보유할 수 있도록 학습하여 최대 10x 사이즈 모델보다도 우월한 성능을 보이는 경우가 많음을 확인함

- 배경

- LLM이 unseen tasks에 대해 문제를 잘 처리할 수 있는 zero-shot ability가 알려짐

- 그러나 단순히 Teacher model의 output을 모방하는 Imitation Learning 방식은 한계가 존재

- 따라서 여러 태스크를 처리 '결과'가 아니라 '방식'을 배워야 한다는 저자의 주장

- Related Works

- Instruction Tuning

- input은 자연어로 된 태스크 설명, output은 desired behavior인 (input, output) 쌍으로 학습

- knowledge-intensive or reasoning ability에 대한 능력이 부족하다는 것은 확인이 됨

- Explanation Tuning

- Orca 1에서 제시되었던 학습 방식으로, instruction tuning보다 훨씬 더 자세하고 일련의 추론 과정을 포함하는 explanation을 바탕으로 학습하도록 함

- system instruction은 user prompt에 관한 high level 가이드라인

- Slow thinking을 할 수 있도록 (system instruction, user prompt, LLM answer) triplet으로 데이터셋을 구축

- Instruction Tuning

- Contributions

- Prompt Erasure 테크닉을 통해 Orca 2를 Cautious Reasoner로 만들었음

- 추론 관련 태스크에서 기존 모델 Orca 1 뿐만 아니라, 70B에 달하는 모델보다도 뛰어난 성능을 보임

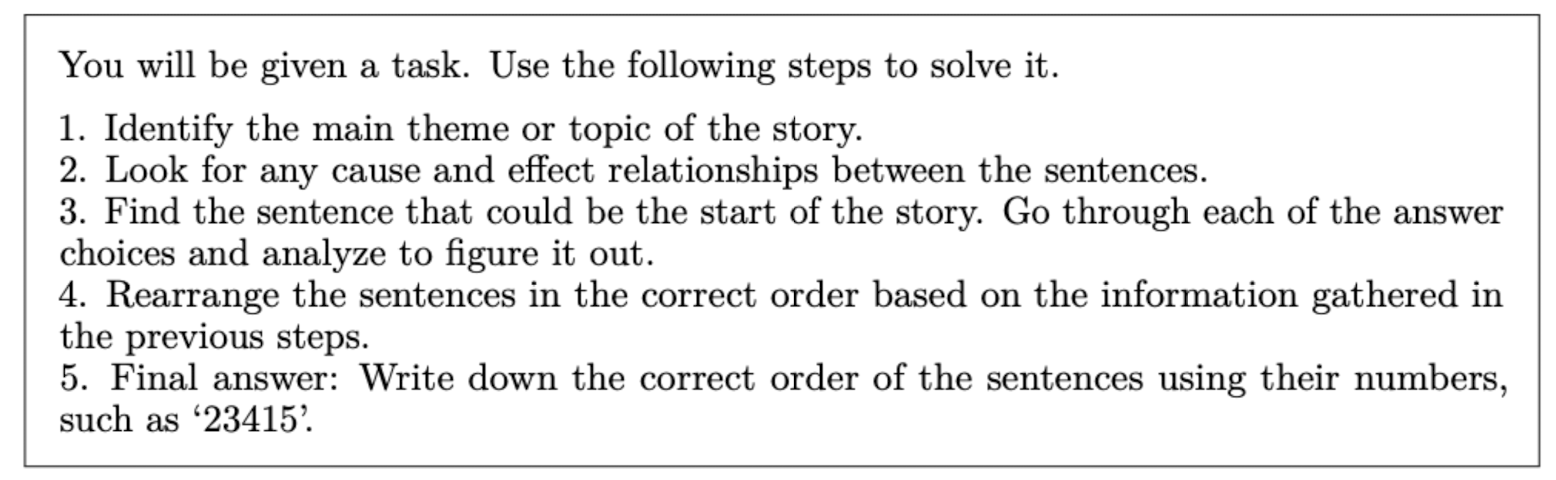

- Teaching Orca 2 to be a Cautious Reasoner

- system instruction을 크게 세 가지 유형으로 구분하여 결과를 비교했을 때, 마지막의 것이 유효한 정답을 반환하는 것이 확인됨

- 1) default GPT-4 answer

- 2) chain-of-thought prompt

- 3) explain-your-answer prompt

- 실제로 최종 결과가 정답이었다고 하더라도 이것이 smaller models에도 적합한 방식인지 생각할 필요가 있음.

이때 다음 내용을 고려해야 함- 1) 태스크마다 최적의 전략이 다르다

- 2) 작은 모델의 태스크별 최적의 전략은 큰 모델의 것과 다를 수 있다

- Cautious Reasoning: 주어진 태스크에 대해 어떤 solution strategy를 취할 것인지 결정

- 1) 다양한 태스크 모음으로 시작

- 2) Orca의 performance에 따라 태스크에 필요한 solution strategy를 결정

- 3) 태스크에 대한 teacher model의 response를 얻기 위해 task-specific system instruction을 작성

- 4) Prompt Erasing: 학습 동안에 student의 system instruction을 태스크에 대해 어떻게 접근할 것인지에 대한 detail이 비워져 있는 generic한 것으로 대체

- Dataset

- FLAN, Few Shot Data, Math, Fully synthetic data

- Baseline

- LLaMA-2 Models, WizardLM, Orca, GPT Models

- system instruction을 크게 세 가지 유형으로 구분하여 결과를 비교했을 때, 마지막의 것이 유효한 정답을 반환하는 것이 확인됨

- Chat model들이 HellaSwag와 같은 text completion에는 적합하지 않은 것으로 원인을 분석했음

- 이걸 포함해서 애초에 왜 Chat model을 썼는지 의문이기는 함

출처 : https://arxiv.org/abs/2311.11045

Orca 2: Teaching Small Language Models How to Reason

Orca 1 learns from rich signals, such as explanation traces, allowing it to outperform conventional instruction-tuned models on benchmarks like BigBench Hard and AGIEval. In Orca 2, we continue exploring how improved training signals can enhance smaller LM

arxiv.org